Изкуственият интелект е екзистенциална заплаха – но не по начина, по който си мислите

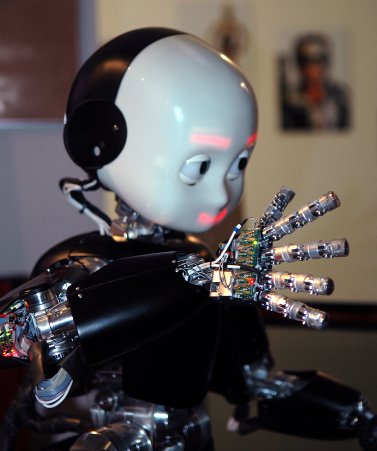

Възходът на ChatGPT и други подобни системи с изкуствен интелект е съпроводен от рязко нарастване и на тревогите относно опасностите, свързани с тях; през последните няколко месеца ръководители и изследователи по безопасността на ИИ предлагат различни прогнози и варианти, в които технологията довежда до мащабна катастрофа.

Тези притеснения достигнаха своя връх през май 2023 г., когато организацията с нестопанска цел Център по безопасност на ИИ публикува изявление, в което фигурира изречението: „Намаляването на риска от това да изчезнем като вид заради ИИ трябва да бъде глобален приоритет наред с други рискове от обществен мащаб, като пандемии и ядрена война.“ Изявлението е подписано от много ключови играчи в областта, включително ръководителите на OpenAI, Google и Anthropic, както и двама от така наречените „кръстници“ на ИИ: Джефри Хинтън и Йошуа Бенгио.

Може да се запитате как се предполага, че ще се проявят подобни екзистенциални страхове. За един от тях – мисловния екперимент с кламерите на Ник Бостром – вече ви разказвахме. Идеята е, че един изкуствен интелект, натоварена със задачата да произвежда възможно най-много кламери, може да предприеме извънредни и непредвидени действия, за да изпълни задачата си, като например да посегне на човечеството с цел да си набави суровини.

В един друг вариант, ИИ, от който се иска да осигури резервация в популярен ресторант, изключва клетъчните кули и светофарите, за да попречи на други посетители да получат маса.

Та общо взето основната идея е една и съща: ИИ бързо се превръща в извънредно способен механизъм, добър в постигането на цели, но опасен, защото невинаги ще се съобрази с моралните ценности на своите създатели. А в най-крайния си вариант този аргумент се превръща в изрични опасения за поробване или унищожаване на човешката раса.

През последните няколко години Нир Айсиковиц и неговите колеги от Центъра за приложна етика към UMass Boston проучват влиянието на ИИ и смятат, че тези катастрофални тревоги са преувеличени и неправилно насочени.

Да, способността на технологията да създава убедителни дълбоко фалшиви видео и аудиоклипове е плашеща и с нея могат да злоупотребяват хора с лоши намерения. Всъщност това вече се случва: Руски агенти вероятно са се опитали да злепоставят един от критиците на Кремъл, Бил Браудър, като са го въвлекли в разговор с аватар на бившия украински президент Петро Порошенко. Киберпрестъпниците използват клонирането на гласове с изкуствен интелект за различни престъпления – от високотехнологични обири до обикновени измами.

Системите с изкуствен интелект, които са интегрирани да одобряват кандидати за заеми или наемане на работа, носят риск от алгоритмична пристрастност, тъй като данните, върху които са обучени и моделите за вземане на решения, с които работят, отразяват дългогодишни социални предразсъдъци.

Това са големи проблеми и изискват вниманието на политиците. Но те съществуват от известно време и едва ли ще предизвикат човекоприключващ катаклизъм.

База за сравнение

Изявлението на Център по безопасност на ИИ го поставя в една група с пандемиите и ядрените оръжия като основен риск за цивилизацията. Това сравнение има своите проблеми. COVID-19 доведе до почти 7 милиона смъртни случая в световен мащаб, предизвика огромна и продължителна криза в областта на психичното здраве и създаде икономически предизвикателства, включително хроничен недостиг по веригата за доставки и бясна инфлация.

Ядрените оръжия вероятно са убили повече от 200 000 души в Хирошима и Нагасаки през 1945 г., отнели са живота на много повече хора от рак през следващите години, породили са десетилетия на дълбока тревога по време на Студената война и са довели света до ръба на унищожението по време на Кубинската ракетна криза през 1962 г. Те също така променят поведението на националните лидери за това как да реагират на международна агресия, както в момента се случва с нахлуването на Русия в Украйна.

ИИ просто не е близо до това да придобие способността да нанася щети с подобен обем.

Сценарият с кламерите и други подобни са научна фантастика. Съществуващите приложения на ИИ изпълняват конкретни задачи и е далеч от това да може да вземе решение и след това да планира целите и подцелите, необходими за спиране на движението, за да ви осигурят място в ресторант, или за взривяване на автомобилна фабрика, за да има материали за кламерчета.

Технологията не само не разполага със сложния капацитет за многопластова преценка, който се изисква за изготвяне и изпълнение на подобни сценарии, но и няма автономен достъп до достатъчно части от нашата инфраструктура, за да започне да нанася такива щети.

Какво означава да бъдеш човек

Всъщност използването на изкуствен интелект крие екзистенциална опасност, но тази опасност е екзистенциална по-скоро във философски, отколкото в апокалиптичен смисъл. ИИ в сегашната си форма може да промени начина, по който хората гледат на себе си, защото може да влоши способностите и преживяванията, които хората смятат за съществени за това да бъдат хора.

Например, ние сме същества, които правят преценки – рационално преценяваме конкретните неща и ежедневно вземаме решения на работното си място и през свободното си време по стотици въпроси. Но все повече от тези решения сега се автоматизират и се предоставят на алгоритми. Докато това се случва, светът няма да свърши. Но хората постепенно ще загубят способността си да правят тези преценки сами. И колкото по-малко решения вземаме, толкова по-лоши ще ставаме в земането на решения.

Или да погледнем ролята на случайността в живота ни – ние ценим (макар и със задна дата) да попаднем случайно на подходящо и вълнуващо място, човек или дейност. Ролята на алгоритмичните системи обаче е да намалят този вид случайност и да я заменят с планиране и прогнозиране.

И накрая, да разгледаме възможностите за писане на ChatGPT. Технологията е в процес на елиминиране на ролята на писмените задания във висшето образование. Но ако това стане, преподавателите ще загубят ключов инструмент за обучение на студентите как да мислят критично.

* * *

С две думи – не, изкуственият интелект няма да убие света. Но все по-безкритичното му възприемане в най-различни тесни контексти може да причини постепенна ерозия на някои от най-важните умения на хората. Алгоритмите вече подкопават способността ни да преценяваме, да се наслаждаваме на случайни приключения и да усъвършенстват критичното си мислене.

Човешкият вид ще преживее тези загуби. Но в процесa начинът ни на съществуване ще обеднеe. И фантастичните тревоги около някакъв катаклизъм, причинен от ИИ, прикриват тези по-фини опасности. Спомнете си известните заключителни редове на Т. С. Елиът от „Кухите хора“:

…

по тоя път светът завършва

не със взрив а с хленч.